IA como feature morreu em 2025. O que vem agora é operação

Se você ficou com a sensação de que 2025 passou mais rápido do que deveria, não foi impressão.

O ano marcou a virada estrutural em que a Inteligência Artificial saiu do papel de “assistente de texto” e entrou no papel de “operador”: planeja, chama ferramentas, mexe em sistemas e entrega trabalho.

Muita empresa perdeu um ponto básico. Execução é operação. Operação tem custo recorrente, risco recorrente, auditoria, controle de acesso, indicador de qualidade e dono. Sem isso, não escala. Em 2025, essa conta chegou.

Em 2025, isso apareceu na prática em duas frentes ao mesmo tempo: modelos mais capazes de raciocinar e agir, e ferramentas que colocam esses modelos dentro do fluxo de trabalho de produto, engenharia, atendimento e conteúdo. O resultado foi um salto de adoção, mas também um salto de confusão, porque “colocar IA” não é mais um botão novo.

Isso ficou visível em duas frentes ao mesmo tempo. Modelos mais capazes de raciocinar e agir. Ferramentas que colocam esses modelos direto no fluxo de produto, engenharia, atendimento e conteúdo. A adoção disparou. A confusão também. Colocar IA deixou de ser “ligar um botão”.

A disputa do ano não foi mais quem treina o maior modelo. Foi quem entrega o melhor sistema. Sistema significa roteamento inteligente, versões especializadas, controle de esforço, segurança embutida e integração real com ferramentas.

É por isso que o foco virou computação na hora de responder e agentes capazes de executar várias etapas sem supervisão constante. A OpenAI deixou isso explícito ao apresentar o GPT-5 como um sistema unificado: modelo rápido, modelo de raciocínio profundo e um roteador em tempo real decidindo custo, latência e qualidade.

É uma decisão de produto disfarçada de decisão técnica: tirar do usuário a escolha do modelo e colocar no sistema a responsabilidade de acertar custo, latência e qualidade. O texto do system card também deixa explícitas as variantes e a linguagem de “respostas seguras” (safe completions), além do modo “pensar pro” com computação paralela para problemas difíceis. Isso é o desenho padrão para 2026: roteador, níveis de esforço e segurança por padrão.

O Google fez o movimento complementar: distribuição.

O anúncio do Gemini 3 mostra a ambição de colocar IA em escala dentro da Busca, do app Gemini, do AI Studio e do Vertex AI, com uma plataforma orientada a agentes. O foco em raciocínio consistente, multimodalidade e contextos longos não é detalhe técnico. É como se cria hábito. Quando a IA entra em produtos de massa, muda o padrão de expectativa do cliente.

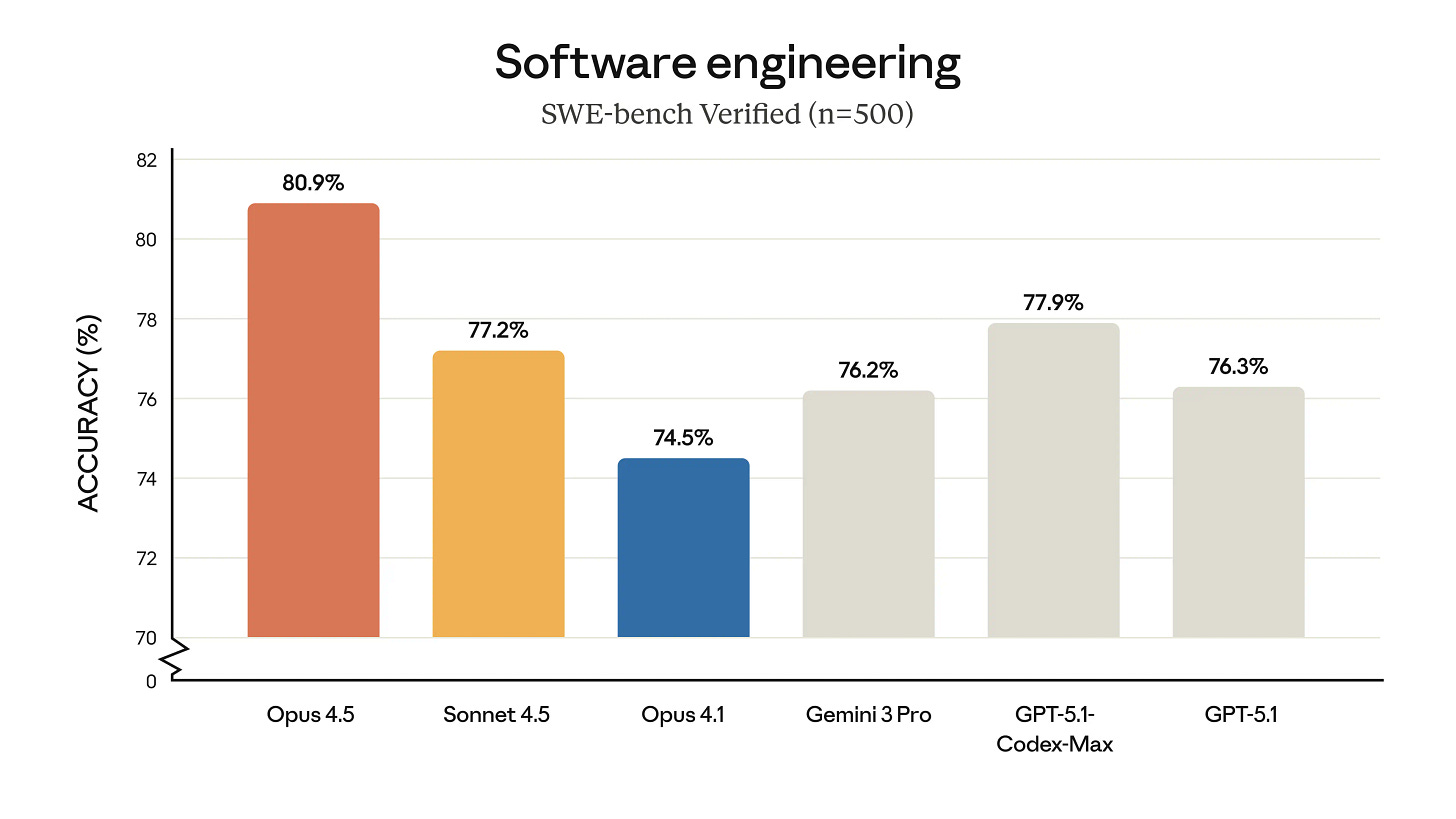

A Anthropic seguiu um caminho mais operacional. No Claude Opus 4.5, a empresa empurrou forte a narrativa de IA que trabalha em ferramentas reais, com preço e controles explícitos. O parâmetro de esforço virou a tradução prática de uma demanda antiga de liderança: controlar custo e tempo por tarefa. Em 2025, falar de IA sem falar de custo unitário ficou indefensável.

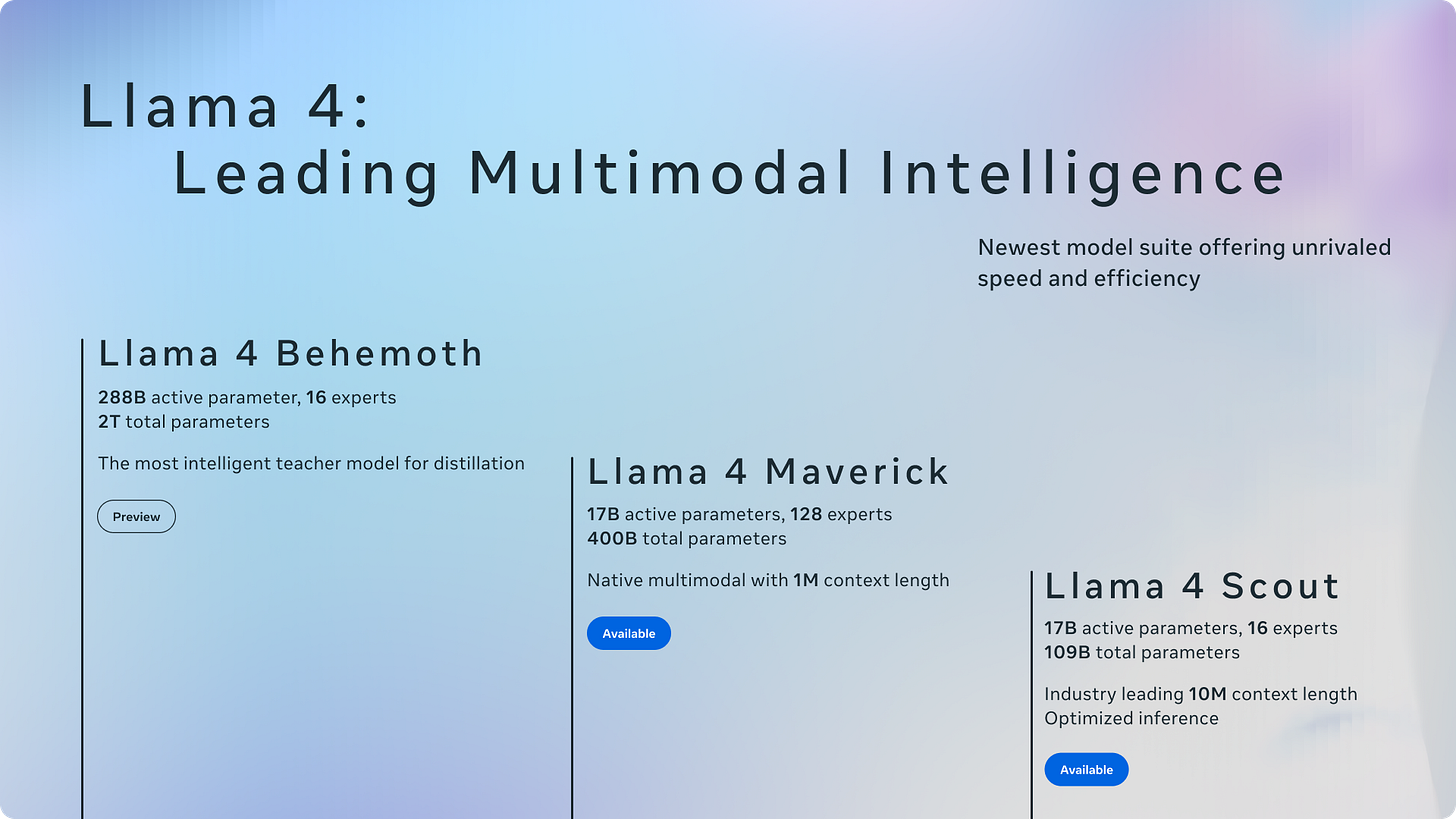

Nos modelos de pesos abertos, o debate amadureceu. A Meta lançou a coleção Llama 4, colocou Scout e Maverick em uso e integrou o Meta AI a WhatsApp e Messenger. Ao mesmo tempo, cresceu a discussão sobre o que “aberto” realmente significa. Para o Brasil, isso importa por um motivo simples: WhatsApp é canal de negócio. Qualquer avanço ali empurra empresas para uma nova camada de relacionamento, com risco e oportunidade juntos.

A China consolidou a outra ponta do tabuleiro. A DeepSeek mostrou que é possível entregar raciocínio competitivo a custo muito menor. A Alibaba reforçou essa direção com a família Qwen3 e a narrativa de raciocínio híbrido. O efeito prático foi mudar o jogo de compras nas empresas. A pergunta deixou de ser “qual é o melhor modelo” e virou “qual entrega o mínimo necessário com risco aceitável”.

O impacto de 2025 aqui não é “quem ganhou o benchmark”, é a normalização de que modelos competitivos podem vir com custo menor, open source e velocidade alta de iteração. Isso muda o jogo de procurement nas empresas: comparar não é mais “qual modelo é melhor”, é “qual modelo entrega o mínimo necessário pelo menor custo e com risco aceitável”.

A Europa, sempre ela, colocou na mesa a política regulatória mais concreta do ano para IA. A Comissão Europeia publicou obrigações que entram em vigor em agosto de 2025, incluindo documentação técnica, política de copyright e resumo de dados de treino. Governança de modelo deixou de ser debate abstrato. Virou checklist. Quem não consegue provar o que faz perde negócio.

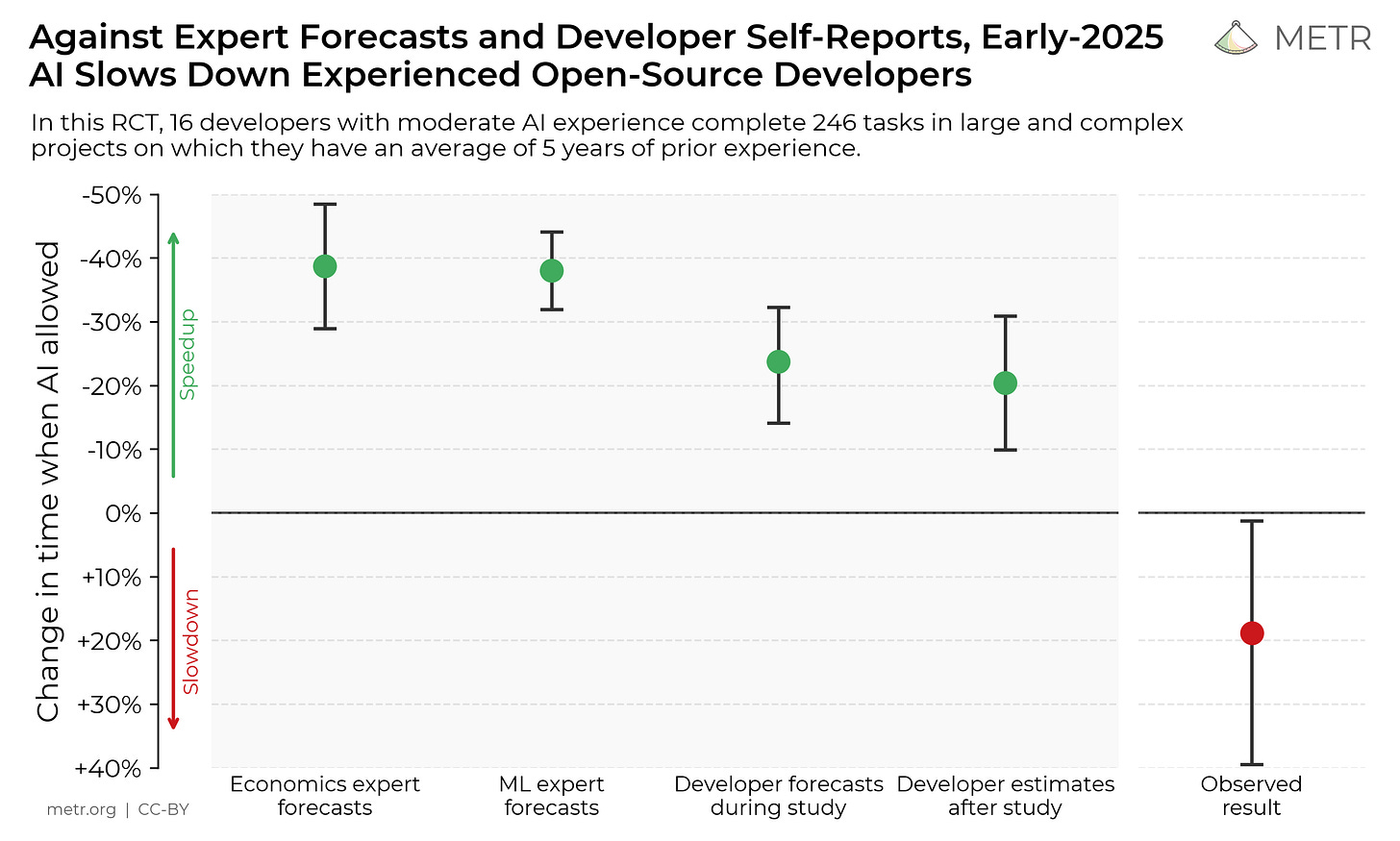

Na camada de ferramentas, 2025 teve um fenômeno cultural com nome próprio: programar no feeling. A expressão viralizou, rodadas vieram junto, mas o dado mais incômodo do ano veio da METR. Em testes controlados com desenvolvedores experientes, usar IA pode deixar o trabalho mais lento, não mais rápido, por causa de revisão, ajuste de prompt e espera. Produtividade não é ter IA. É desenhar o fluxo certo para ela.

O Lovable mostrou o outro lado da moeda. Quando o produto inteiro acerta, a adoção explode. O crescimento de receita recorrente anual virou símbolo de que a camada de aplicativo captura valor mais rápido que a camada de modelo. O custo oculto é operacional: essas ferramentas empurram engenharia fora do radar. Sem governança, a empresa vira um conjunto de sistemas paralelos.

Infraestrutura e energia deixaram de ser pano de fundo. Custo de inferência, consumo elétrico e hardware viraram tema de CFO. A Agência Internacional de Energia colocou números nessa equação. Ao mesmo tempo, avanços em fusão reacenderam a discussão sobre limite físico da IA. Mesmo sem solução imediata, a pergunta ficou inevitável: quem paga a conta.

Conteúdo sintético também deixou de ser brincadeira. O lançamento do Sora 2 e do Veo 3 aumentou produtividade criativa e aumentou fraude. Deepfakes passaram a aparecer em bases públicas de incidentes. Plataformas responderam com políticas de rotulagem, mas a dúvida pública ficou.

Segurança saiu do campo opinativo. O relatório do AI Security Institute do Reino Unido colocou métricas em temas antes abstratos. Para empresas brasileiras, isso muda o debate. Sem métrica, vira discurso. Com métrica, vira gestão de risco.

No Brasil, 2025 consolidou a virada institucional. O PL 2.338 avançou, o Banco Central incluiu IA nas prioridades regulatórias e a ANPD colocou o tema na agenda. Compliance deixou de ser opcional. A empresa que tratar isso como burocracia perde tempo. A que tratar como trilho ganha escala com menos susto.

2026 começa com uma pergunta simples e desconfortável. Onde você quer execução automática e onde você exige confirmação humana?

O erro comum em 2025 foi dar poder de execução sem processo organizado, sem dado confiável e sem critério de qualidade, e depois culpar o modelo. A tecnologia já permite agentes. A maturidade agora é saber limitá-los.

Para product managers, IA como feature morreu rápido. O trabalho virou decidir quando a IA responde, quando age e quando deve ficar quieta. Isso é experiência, governança e métrica de confiança. Não é só engajamento.

Se este texto ajudou você a organizar 2025 sem cair no oba oba, compartilhe com quem está “colocando IA” em tudo. E responda sem rodeio: em 2026, onde a IA pode executar sem pedir permissão, e onde ela nunca deve agir sozinha?

Bom resumo do que foi o ano de 2025 e pouco do que vai ser 2026.

Isso que é matéria completa. Obrigado por partilhar ❤️