A Anthropic cresce rápido demais

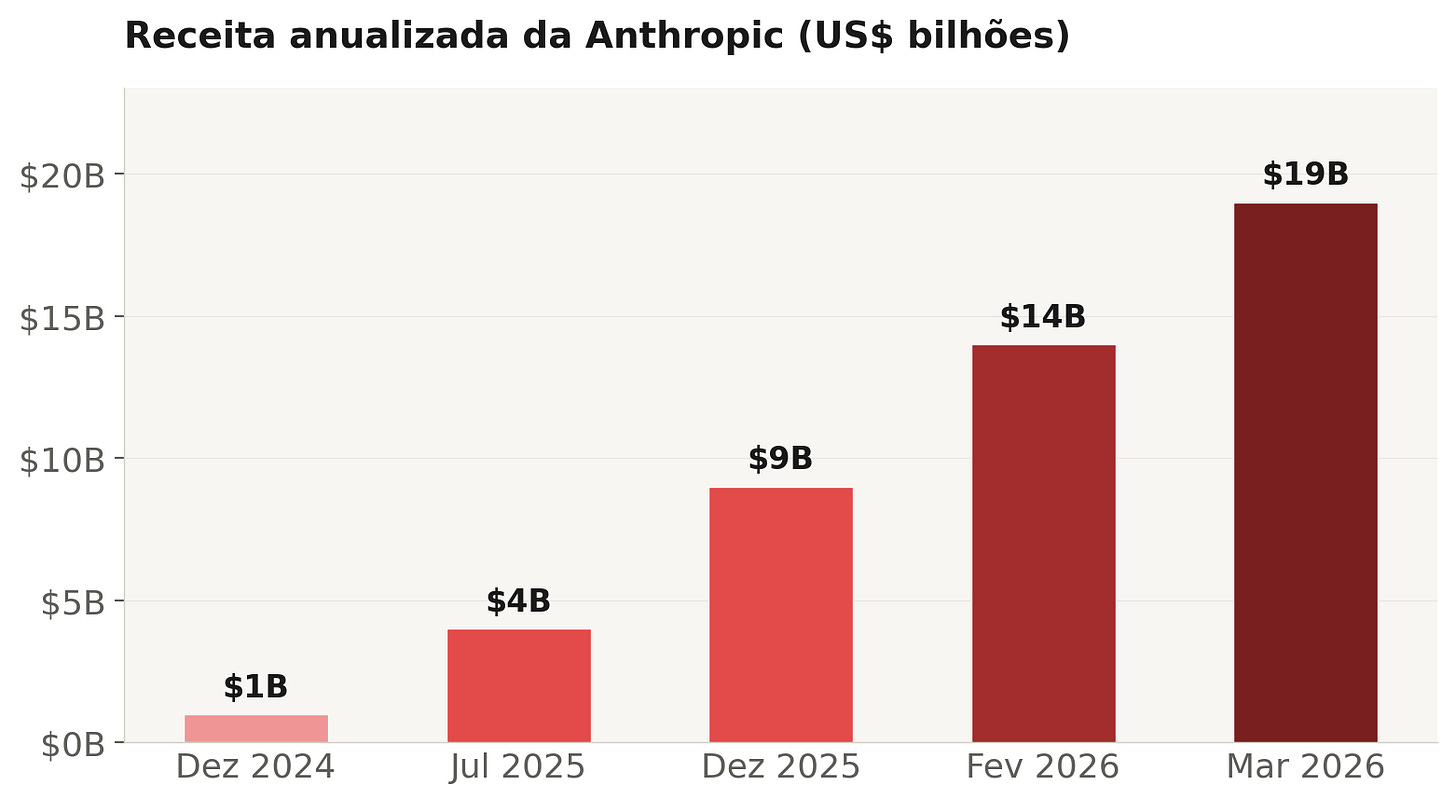

A Anthropic saiu de US$ 1 bilhão em receita anualizada em dezembro de 2024 para US$ 19 bilhões em março de 2026, nenhuma empresa de software B2B na história chegou perto dessa velocidade. O Claude Code, que só ficou disponível ao público em maio de 2025, já gera US$ 2,5 bilhões em receita anualizada, nove meses depois do lançamento, outro número que impressiona é que 4% de todos os commits públicos no GitHub já são escritos pela ferramenta. Oito das dez maiores empresas do Fortune 10 são clientes e mais de 500 empresas gastam mais de US$ 1 milhão por ano com o Claude.

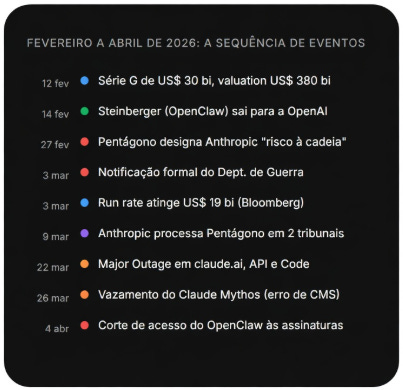

Os números contam uma história de tração gigantesca mas os números também contam outra história, que apareceu com força entre março e abril de 2026: a de uma empresa que está vendendo mais do que consegue entregar, cortando acesso de quem atrapalha a margem, comprando briga com o Pentágono e transferindo bilhões para os mesmos parceiros de nuvem dos quais tenta se livrar.

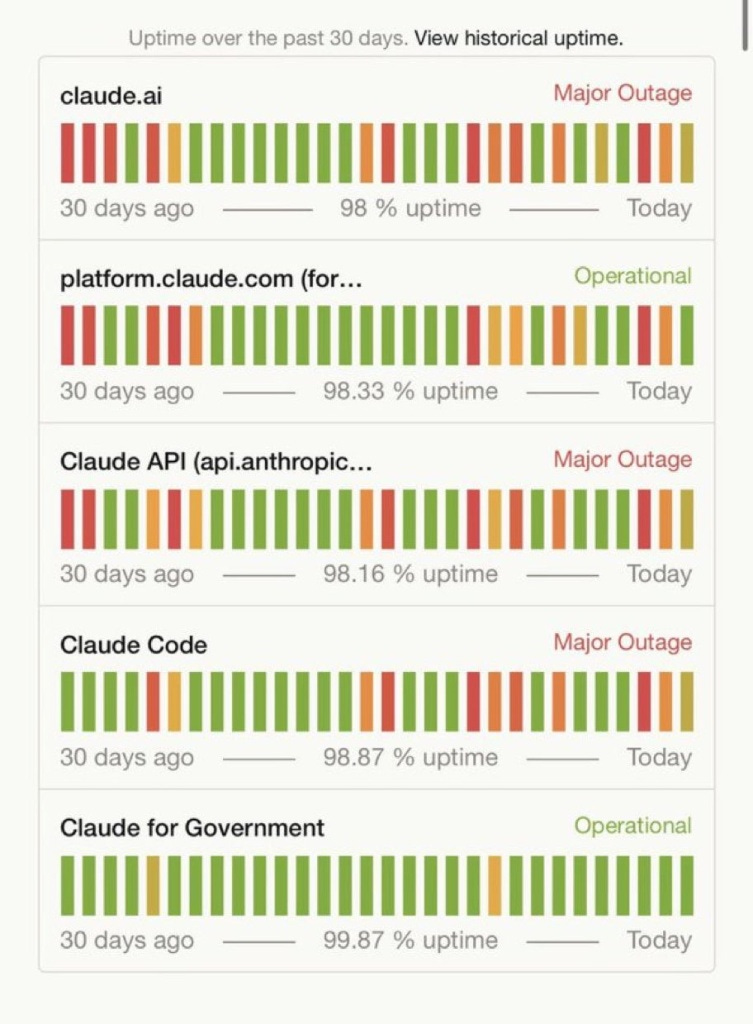

Em março, o claude.ai, a API pública e o Claude Code sofreram interrupções graves ao longo de semanas. Os painéis de status da própria empresa registraram “Major Outage” nos três serviços durante o período de 30 dias. A disponibilidade caiu de 98,93% em fevereiro para 98,21% em março. Usuários do plano Max, que paga entre US$ 100 e US$ 200 por mês e promete até 20 vezes mais uso que o Pro, reportaram esgotamento total do limite em 10 a 15 minutos de conversa com o Opus.

Alguns viram seus medidores de uso pular de zero para 91% em três minutos, sem ter enviado um prompt sequer. O Downdetector registrou mais de 2.140 reclamações simultâneas no dia 23 de março.

Enquanto isso, dois serviços ficaram intocados: o platform.claude.com, que cuida de faturamento e gestão, e o Claude for Government, que opera em clusters isolados para contratos federais. A infraestrutura que atende o governo americano roda em domínios de falha separados, com redundância de hardware dedicada. A que atende o resto do mundo divide recursos numa nuvem multilocatária que simplesmente não aguentou o volume.

A causa raiz tem nome: velocidade de lançamento. Entre maio de 2025 e fevereiro de 2026, a Anthropic lançou o Opus 4, depois o 4.1, depois o 4.5, o Haiku 4.5, o Sonnet 4.6 e o Opus 4.6. Cada modelo trouxe janelas de contexto maiores, capacidades de raciocínio mais pesadas e tarefas mais complexas, que puxam mais computação por requisição.

Um estudo da própria Anthropic mostrou que usuários com mais tempo de plataforma aprenderam a extrair respostas mais profundas, o que consome mais processamento por interação. O Claude Code adicionou uma camada de uso autônomo e contínuo sobre essa mesma infraestrutura e o resultado foi previsível: demanda crescendo mais rápido que a capacidade de servir.

A resposta da empresa para o descompasso não foi só técnica, ela também no aspecto comercial. No dia 3 de abril de 2026, uma sexta-feira à noite, a Anthropic mandou um e-mail aos assinantes avisando que, a partir do dia seguinte ao meio-dia, assinaturas do Claude Pro e Max não cobririam mais o uso de ferramentas de terceiros.

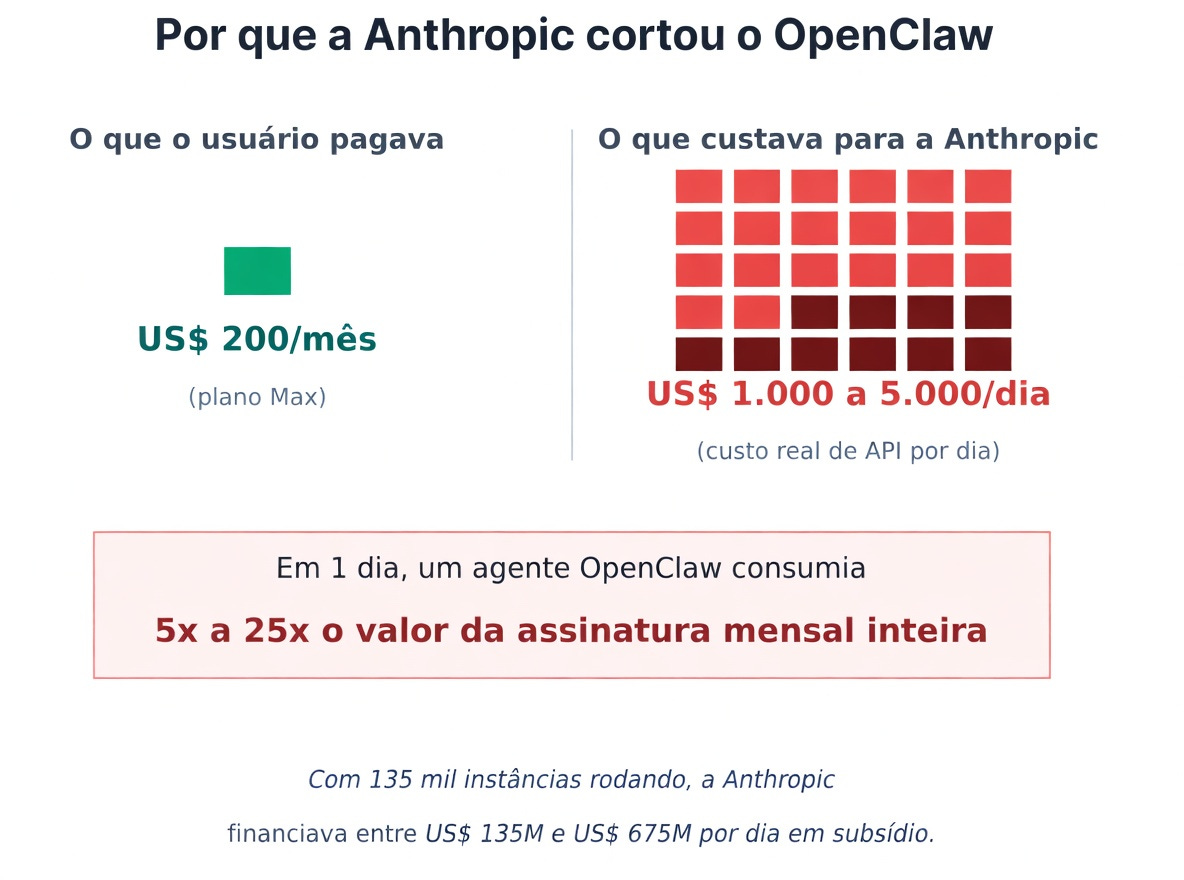

O alvo explícito era o OpenClaw, um agente de IA de código aberto que tinha 347 mil estrelas no GitHub e mais de 135 mil instâncias rodando naquele momento. Para se ter uma ideia, um único agente OpenClaw rodando o dia inteiro num plano Max de US$ 200 por mês consumia entre US$ 1.000 e US$ 5.000 em custo equivalente de API.

A Anthropic estava subsidiando essa diferença para cada usuário que roteava automações pelo plano fixo.

Boris Cherny, o chefe do Claude Code, explicou a lógica por trás da decisão com um argumento técnico:

As ferramentas internas da Anthropic são construídas para reutilizar blocos de contexto que já foram processados na memória das GPUs, o chamado prompt cache.

Quando o Claude Code roda uma tarefa, ele mantém uma taxa alta de reaproveitamento desse cache, o que reduz o custo por requisição. Quando um framework externo como o OpenClaw injeta instruções e contexto de forma diferente, ele força o modelo a recalcular pesos de atenção sobre janelas inteiras de contexto a cada iteração. Num modelo do tamanho do Sonnet 4.6 operando com 200 mil tokens de contexto, cada requisição sem cache vira um dreno financeiro. Para uma empresa que paga prêmios pesados por tempo de GPU alugado, hospedar agentes autônomos ilimitados por uma taxa fixa mensal equivale a financiar o próprio prejuízo.

A mecânica do corte revela a intenção da Anthropic que não baniu o uso do OpenClaw com o Claude, ela forçou esse uso para o modelo pay-as-you-go, onde cada chamada custa entre US$ 0,50 e US$ 2,00. Ao mesmo tempo, isentou explicitamente suas próprias ferramentas: Claude Code e Claude Cowork continuam cobertos pela assinatura. Peter Steinberger, o criador do OpenClaw, tinha saído da órbita da Anthropic e ido para a OpenAI em fevereiro de 2026. Antes de ir, tentou negociar com a liderança da Anthropic e conseguiu apenas um adiamento de uma semana, já Sam Altman prometeu publicamente suporte institucional ao OpenClaw como projeto da comunidade de desenvolvedores.

A Anthropic, por sua vez, confirmou a remoção das chaves OAuth usadas pelos serviços de terceiros via commits diretos no GitHub.

Para amaciar a transição, a empresa aplicou uma tática de economia comportamental com três partes.

Ofereceu um crédito de uso extra equivalente ao valor da assinatura mensal, resgatável até 17 de abril. Usuários do plano Max receberam entre US$ 100 e US$ 200 em créditos com validade de 90 dias.

Disponibilizou descontos de até 30% na compra antecipada de pacotes de uso extra.

Terceiro, ofereceu reembolso integral para quem quisesse cancelar.

O crédito gratuito tem um propósito preciso, para resgatar, o usuário precisa entrar nas configurações e ativar a opção de “uso extra”, configurando limites de recarga automática. Uma vez que os créditos promocionais acabam sob a demanda de codificação e geração de texto, a inércia comportamental faz com que o pagamento automático continue gerando receita incremental.

É a mesma lógica que apps de delivery usam com cupons de primeira compra, só que aplicada a infraestrutura de computação pesada. O efeito prático é inflar a receita média por usuário de forma durável.

🔗 Construa uma carreira à prova do futuro, liderando produtos mais inteligentes e eficientes com IA. Acesse: https://go.pm3.com.br/ProductGurus-AI-Specialist

Cupom de 10%: PRODUCTGURUS

Em paralelo, a Anthropic dobrou os limites de uso diário para todas as contas durante duas semanas no final de março, vendido como “um pequeno agradecimento a todos que usam o Claude”. A condição não anunciada: o benefício só valia fora do horário de pico.

A estratégia é a mesma que companhias aéreas e hotéis usam há décadas para preencher capacidade ociosa, os GPUs e TPUs custam o mesmo estejam calculando inferências ou paradas, então empurrar desenvolvedores para a madrugada e fins de semana preenche os vales no gráfico de utilização dos data centers, maximiza o retorno sobre o ativo e adia o momento em que a empresa precisaria comprar ou alugar dezenas de milhares de aceleradores adicionais para cobrir picos de demanda diurna.

Toda essa engenharia de monetização opera sobre uma base financeira que é, em si mesma, um paradoxo. A Anthropic levantou US$ 30 bilhões numa Série G em fevereiro de 2026, a uma avaliação de US$ 380 bilhões. O capital total injetado na empresa ao longo de todas as rodadas passa de US$ 50 bilhões, já a receita cresce 10x ao ano há três an

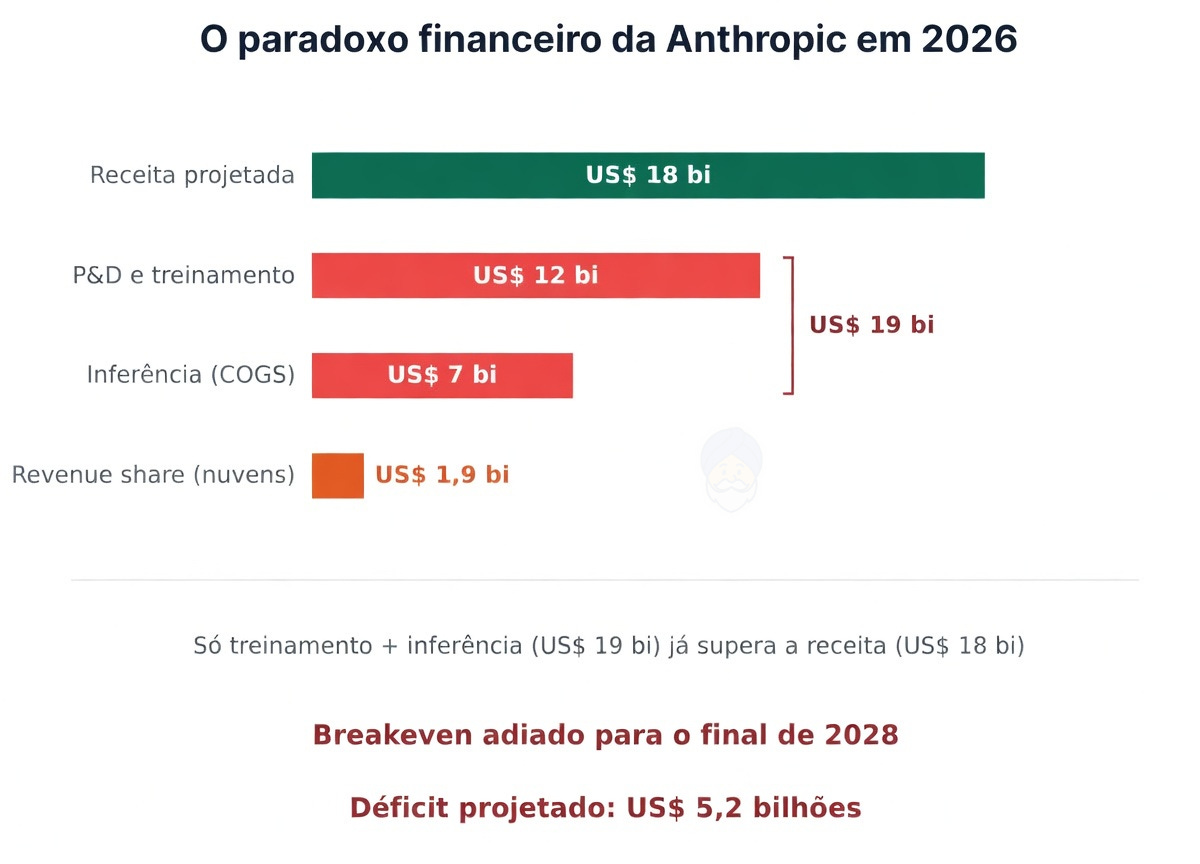

os consecutivos. E mesmo assim o breakeven financeiro foi empurrado para o final de 2028, com um déficit projetado de US$ 5,2 bilhões sobre o faturamento original.

Os números explicam por quê, a projeção de gastos em pesquisa e desenvolvimento focada no treinamento dos modelos pós-Claude 4 é de US$ 12 bilhões em 2026. O custo de manter a inferência rodando para os clientes atuais consome outros US$ 7 bilhões, só a soma de treinamento e inferência dá US$ 19 bilhões, que já supera a projeção de receita de US$ 18 bilhões antes de entrar qualquer despesa com vendas, marketing ou salários dos pesquisadores.

Existe uma variável ainda mais corrosiva nessa equação que é, a Anthropic é o único modelo de IA de fronteira disponível nas três maiores plataformas de nuvem do mundo: AWS Bedrock, Google Vertex AI e Microsoft Azure Foundry.

Essa distribuição ampla gera vendas, mas cobra um preço pesado que as estimativas financeiras apontam que a empresa vai transferir US$ 80 bilhões em compensações para os parceiros de nuvem até 2029. O repasse para a Amazon sobre as vendas feitas via Bedrock chegou a quase 50% do lucro bruto gerado pela comercialização do Claude naquele canal. Em 2024, esse repasse era de US$ 1,3 milhão. Em 2025, pulou para US$ 360 milhões. Em 2026, a projeção é de US$ 1,9 bilhão. Em 2027, de US$ 6,4 bilhões.

No final de 2025, a Anthropic anunciou um investimento de US$ 50 bilhões em infraestrutura própria nos Estados Unidos, em parceria com a Fluidstack, uma operadora de nuvem especializada em data centers sob medida para cargas de IA. O projeto divide a rede em dois polos com funções distintas: complexo do Texas, onde a energia custa entre US$ 0,04 e US$ 0,06 por kWh, concentra o treinamento de modelos futuros, que não depende de latência baixa e o complexo de Nova York atende a inferência para clientes corporativos, posicionado perto das artérias do sistema financeiro que exigem proximidade de fibra óptica para operações em milissegundos.

A filosofia é oposta à do Project Stargate da OpenAI, que aposta US$ 500 bilhões num monolito centralizado de 10 gigawatts previsto para 2029. A Anthropic distribui risco entre dezenas de acordos cruzados com Google Cloud (até 1 milhão de TPUs), AWS (escalando de 500 mil para 1 milhão de chips Trainium2) e Microsoft Azure.

O CFO da empresa diz que esse mosaico protege contra choques em componentes específicos, mas existe a fragilidade do modelo aparece na engenharia de software: orquestrar treinamento e inferência sobre chips de arquiteturas completamente diferentes (TPUs do Google, Trainium da Amazon, GPUs Blackwell da Nvidia) impõe uma complexidade que contribui para a instabilidade que apareceu em março.

Para piorar a situação, em 26 de março, um erro de configuração no sistema de gerenciamento de conteúdo da Anthropic expôs publicamente servidores e repositórios sem autenticação. Entre minutas de comunicados e documentos internos, estava o material sobre o Mythos, classificado internamente como o modelo mais avançado já construído pela empresa, com capacidades de exploração de vulnerabilidades cibernéticas que os próprios documentos reconheciam como capazes de superar as defesas de nações e grandes corporações. A Anthropic admitiu que o modelo existia e estava prestes a ser lançado, os investidores deduziram que ferramentas desse tipo reescrevem a assimetria entre ataque e defesa no ciberespaço, e as ações de empresas de cibersegurança derreteram centenas de bilhões de dólares numa única sessão de bolsa.

A Anthropic de abril de 2026 é uma empresa que cresce a uma velocidade sem precedente no software B2B enquanto gasta mais do que fatura, que cobra dos desenvolvedores o custo real da computação que eles consomem enquanto tenta construir data centers próprios para parar de pagar imposto às nuvens, que mantém duas linhas vermelhas sobre uso militar enquanto briga com o governo mais poderoso do mundo, que vaza documentos sobre modelos com capacidade ofensiva cibernética enquanto vende segurança como diferencial de marca.

A receita pode continuar dobrando a cada poucos meses, mas os US$ 80 bilhões em repasses para AWS, Google e Microsoft até 2029 vão continuar saindo do caixa. Os data centers próprios no Texas e em Nova York podem levar anos até aliviar a conta. E toda empresa que depende do Claude para operar sabe agora, depois de março, que a infraestrutura pode cair e que as regras de acesso podem mudar numa sexta-feira à noite.

Para ajudar negócios a escalarem, sem perder tempo com tarefas repetitivas, a Pingback automatiza marketing e vendas. Com essa plataforma, você pode criar formulários personalizados, segmentar listas de contatos, disparar e-mails e mensagens via WhatsApp, gerenciar leads no CRM e acessar conteúdos educativos para otimizar suas estratégias. Tudo isso em um único lugar.

É ideal para times que buscam uma plataforma simples, leve e rápida.