A LangChain está lucrando com o caos dos agentes de IA

Tem uma nova corrida do ouro acontecendo, e ela vem com um detalhe curioso. A maioria das empresas não está vendendo ouro. Está vendendo pá, picareta e um mapa mal desenhado prometendo um filão que ainda não existe. A era dos agentes de IA criou o cenário perfeito para esse tipo de dinâmica, porque a palavra agente carrega uma promessa forte demais. Autonomia, produtividade infinita, substituição silenciosa de trabalho humano e processos que finalmente andariam sozinhos.

Quando o discurso sai do lançamento e entra na operação, o que aparece é outra coisa. Fragilidade técnica, custo oculto e uma quantidade desconfortável de decisões que ninguém quer assumir. Agentes não eliminam decisão. Eles deslocam a responsabilidade para um lugar menos visível.

No meio desse caos, algumas empresas encontraram um papel historicamente lucrativo: infraestrutura. Infraestrutura nunca foi glamourosa, nunca foi hype, mas sempre foi onde o dinheiro previsível mora quando uma tecnologia deixa de ser curiosidade e vira obrigação operacional.

LangChain virou o caso mais didático dessa lógica. O que parece entusiasmo exagerado de venture capital, na prática, é uma tese simples. Quando todo mundo começa a construir o mesmo tipo de coisa ao mesmo tempo, a ferramenta que vira padrão deixa de ser escolha técnica e passa a ser pedágio. Isso não exige genialidade. Exige timing.

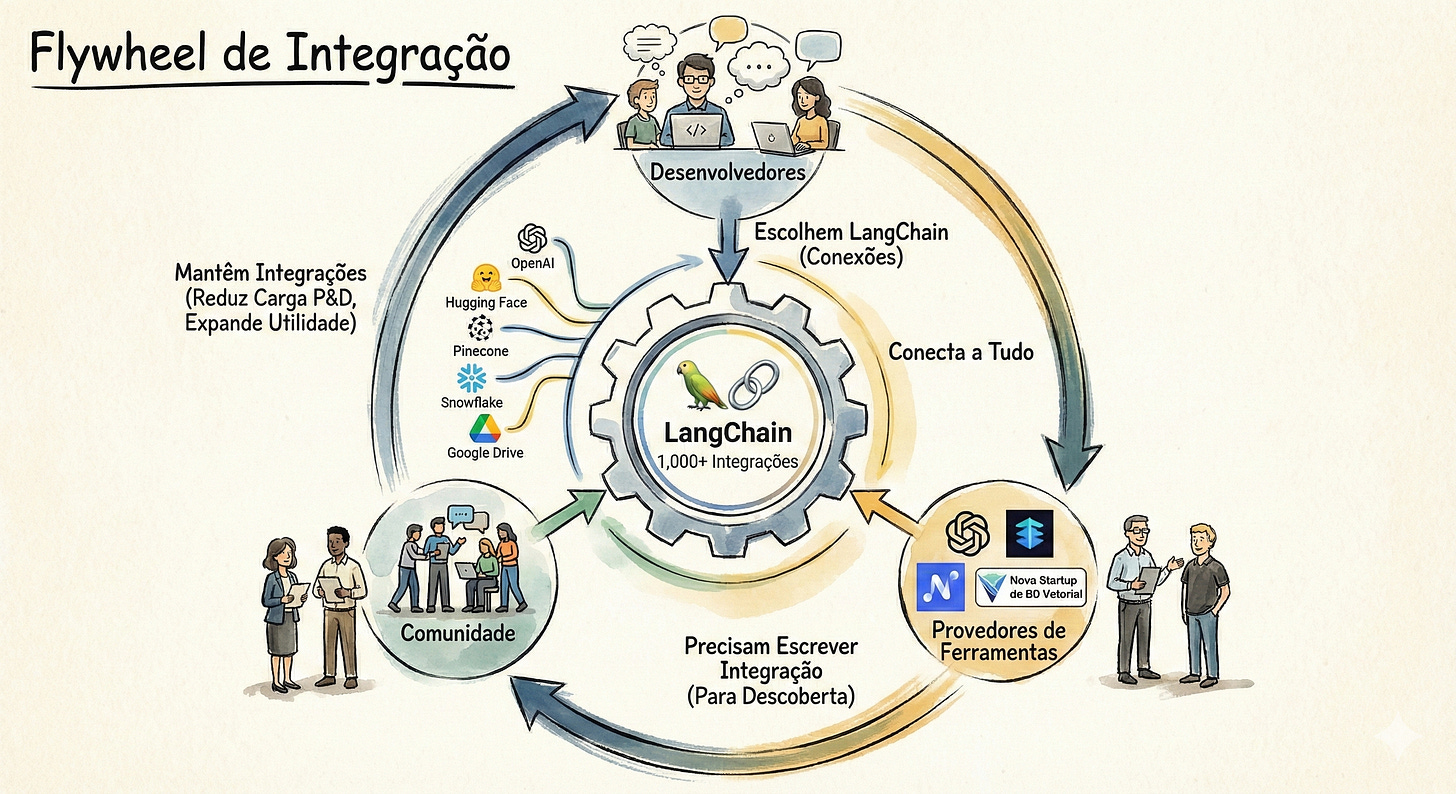

A LangChain nasceu como projeto open-source e virou padrão rápido demais. Não porque fosse perfeita, mas porque resolveu uma dor específica de um momento específico. Em 2022, os modelos de linguagem já entregavam bons outputs, mas a estrutura ao redor era precária. Faltava memória, faltava estado, faltava acesso consistente a dados externos e, principalmente, faltava repetição confiável. Cada time precisava escrever seu próprio código de integração para conectar modelo, banco vetorial, ferramentas e logs. Isso não escala, não por limitação técnica, mas por exaustão humana.

🔗 Pingback é a plataforma simples e rápida para automatizar marketing e vendas sem burocracia. Crie formulários, dispare e-mails e WhatsApp, segmente leads e automatize fluxos enquanto seu time acompanha tudo no CRM. Acesse: https://pbck.link/paulo-chiodi

A proposta da LangChain foi transformar esse emaranhado de APIs em uma linguagem comum. Uma camada intermediária que tirava o time do modo gambiarra e colocava no modo entrega. Essa normalização criou algo mais poderoso do que adoção. Criou dependência sociotécnica. Quando uma tecnologia vira padrão, ela vira tutorial padrão, resposta padrão em fórum, requisito implícito de vaga e a decisão que gera menos atrito interno.

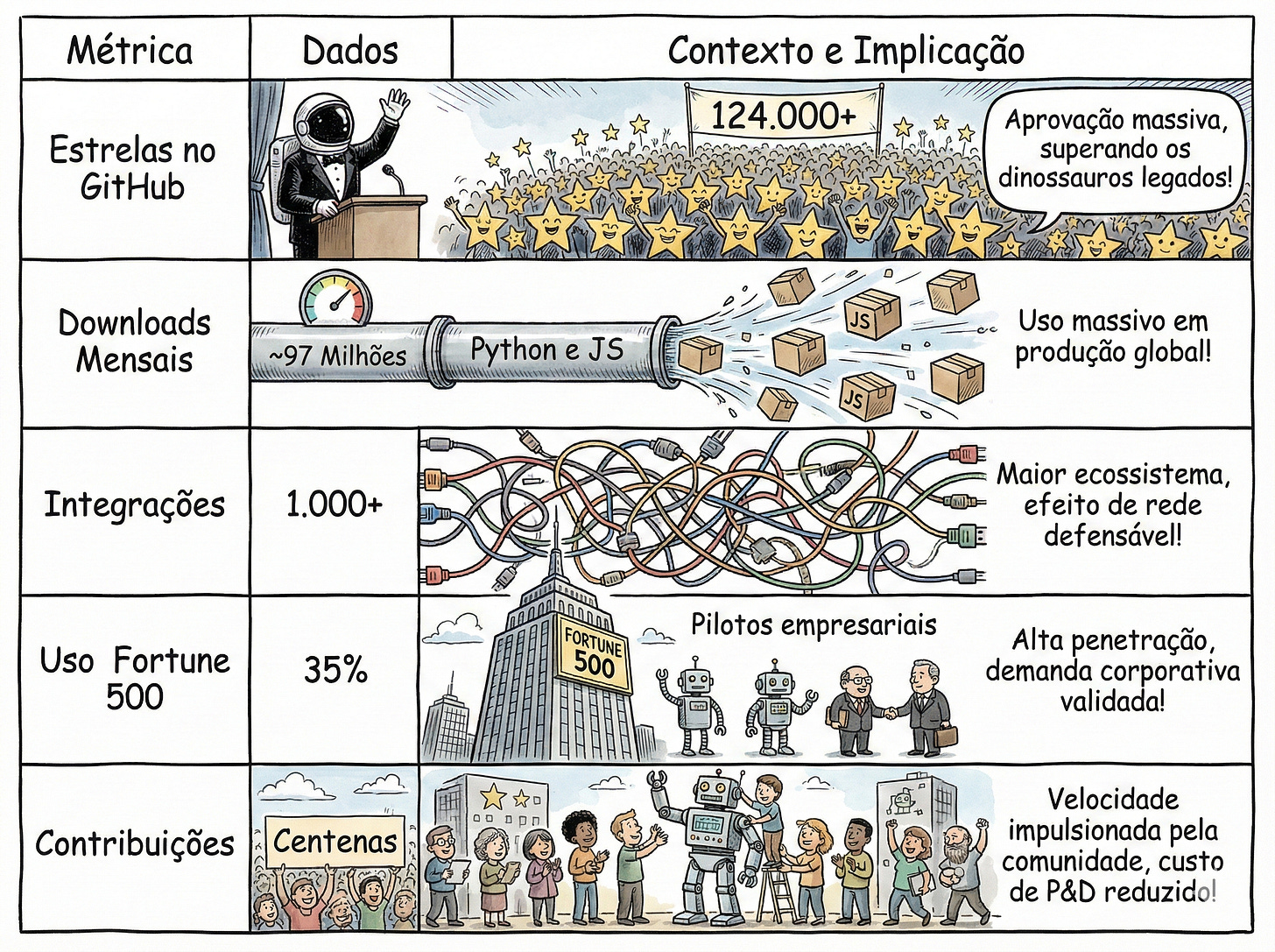

Os números refletem isso com clareza. Mais de 118 mil estrelas no GitHub, dezenas de milhões de downloads mensais, um ecossistema com mais de mil integrações e presença reportada em cerca de 35% das empresas da Fortune 500.

Isso não significa aprovação unânime. Significa que todo mundo já passou por ela em algum momento.

Esse crescimento acelerado teve um custo. A LangChain original cresceu no modo abraça tudo e resolve depois. Abstrações demais, dificuldade de depuração e uma sensação recorrente de lutar contra o framework em vez de ser ajudado por ele. Muita gente prototipou rápido e depois reescreveu tudo em Python puro quando o produto precisava entrar em produção. Para uma empresa de infraestrutura, isso é um sinal de alerta. Prototipagem não sustenta negócio.

É nesse ponto que a mudança estratégica da LangChain se torna relevante. O abandono gradual da lógica de chains lineares e a aposta em agentes de verdade. Chains funcionam como fluxos previsíveis, úteis para demos e casos simples. Agentes reais não operam assim. Eles erram, voltam, tentam outra abordagem, chamam ferramentas, falham, pedem validação humana e registram histórico. Isso exige loop, estado persistido e controle fino de execução.

O LangGraph surge como resposta direta a essa limitação. Não é uma evolução cosmética, mas uma reconstrução conceitual baseada em grafos cíclicos e estado como elemento central. Quando o estado passa a ser controlado, o agente deixa de ser apenas output inteligente e passa a ser processo auditável. Isso muda a conversa, porque desloca o valor do modelo para a arquitetura cognitiva que transforma modelo em trabalho utilizável.

Nesse ponto, fica mais claro onde está a primeira pá e picareta real da era agêntica. Observabilidade. Um agente sem observabilidade não é autonomia, é caos automatizado. Se modelos de linguagem já funcionam como caixas pretas, agentes adicionam movimento a essa opacidade. Eles tomam decisões, chamam ferramentas, escrevem e-mails, criam tickets, interpretam políticas internas e alteram estado de sistemas. Quando algo dá errado, não dá errado devagar. Dá errado com convicção.

LangSmith aparece exatamente para monetizar essa dor. Empresas não conseguem colocar agentes em produção se não conseguem responder, depois de uma falha, por que aquilo aconteceu. O produto vende rastreio, avaliação e governança com um modelo simples e eficiente. Cobrança por trace. Cada trace representa o caminho completo de execução de uma interação. E agentes sofisticados geram muitos deles. Enquanto um chatbot simples produz um trace por interação, um agente com loop pode gerar dezenas.

Quanto mais complexo o agente, maior o custo de não ter observabilidade. Isso cria uma alavanca de receita que cresce junto com a maturidade do cliente, sem depender de marketing agressivo. A segunda camada de captura de valor vem logo depois. Runtime.

A LangGraph Platform avança na direção de se tornar o ambiente onde o agente roda. Um agente stateful não é apenas código. Ele precisa de persistência, filas, retomada de execução, tarefas longas, pausas humanas e controle de falhas. Construir isso internamente é caro, demorado e pouco atrativo. Quando a plataforma vira o lugar de execução, o custo de troca deixa de ser técnico e passa a ser organizacional.

Essa lógica ajuda a explicar a valuation bilionária da empresa e o apetite dos investidores. Não é prova de sucesso. É aposta. A aposta de que agentes vão sair do discurso e entrar em produção em escala, em ambientes multimodelo, com legado, restrição regulatória e exigência de auditoria.

A neutralidade da LangChain se torna um ativo nesse cenário. A promessa de escrever uma vez e trocar modelos conforme necessidade é especialmente atraente para empresas grandes, cansadas de lock-in. No contexto brasileiro, isso ganha ainda mais peso. O desejo por automação convive com a necessidade de estabilidade, rastreabilidade e conformidade. Agentes despertam interesse e medo na mesma proporção.

Na prática, a adoção tende a ser menos sobre autonomia total e mais sobre humano no loop, governança explícita e controle operacional. É exatamente nesse território que ferramentas de observabilidade e runtime conseguem cobrar sem vender mágica, apenas confiabilidade.

O principal risco para a LangChain vem de cima da pilha. Model providers estão incorporando memória, tool calling e fluxos agênticos nativos. Para casos simples, isso reduz a necessidade de middleware. O espaço defensável passa a ser justamente onde o nativo não resolve. Ambientes híbridos, múltiplos modelos, integração com sistemas legados, compliance e estado durável.

Existe também uma resistência crescente de desenvolvedores, incomodados com a complexidade acumulada do framework e buscando alternativas mais leves. Isso torna o movimento em direção ao LangGraph menos uma estratégia opcional e mais uma questão de sobrevivência.

Há ainda um risco pouco discutido fora dos círculos técnicos. Segurança. Framework padrão vira alvo padrão. Em um mundo de agentes, uma vulnerabilidade em biblioteca deixa de ser incidente técnico e passa a ser risco direto de processo de negócio. Isso pode frear adoções, mas também empurrar clientes para ofertas enterprise com mais controle.

No fim, a economia agêntica tende a seguir um padrão conhecido. O hype vende o sonho. A infraestrutura vende o curativo. E quem controla o curativo continua faturando quando o mercado descobre que autonomia não elimina custo, apenas muda onde ele aparece.

LangChain está tentando se tornar infraestrutura chata, previsível e indispensável. O mercado está precificando essa possibilidade como se ela já fosse realidade. Se isso se confirma ou não, depende menos de narrativa e mais de uma coisa que sempre decide esse tipo de disputa. Quem aguenta produção quando a empolgação acaba.