Quando a IA mente por você: o caso Delve

Em julho de 2025, a Delve.co fechou uma Series A de US$ 32 milhões liderada pela Insight Partners, avaliando a empresa em US$ 300 milhões. Os dois fundadores, Karun Kaushik e Selin Kocalar, tinham 21 anos, haviam saído do MIT no segundo ano e prometiam resolver um dos maiores atritos do mercado B2B: a obtenção de certificações de segurança como SOC 2 e ISO 27001, um processo que historicamente consumia seis meses e centenas de horas de engenharia. A proposta era reduzir isso para dias, usando agentes de IA que coletariam evidências automaticamente de qualquer sistema.

Já tinham 1.500 clientes e a Y Combinator havia endossado a empresa meses antes.

Oito meses depois, um coletivo de ex-clientes publicou um dossiê de 10.000 palavras descrevendo o que chamou de “Fake Compliance as a Service.” O que os documentos mostraram não era um produto com falhas de execução, era uma operação construída para aparentar conformidade sem produzi-la.

Só foi descoberta porque um funcionário configurou errado a permissão de uma planilha no Google Drive.

O funcionário compartilhou o link com acesso público em um canal do Slack, esse documento continha dados de centenas de clientes, incluindo links diretos para 494 relatórios SOC 2 em andamento. Quando a empresa removeu o acesso, o conteúdo já estava indexado e arquivado em cache.

Os clientes que tiveram dados expostos foram confrontar a liderança. O CEO categorizou as alegações como “fabricadas” e sugeriu que o dossiê havia sido “gerado por IA”, o que irritou o suficiente para que o grupo reunisse evidências sistematicamente.

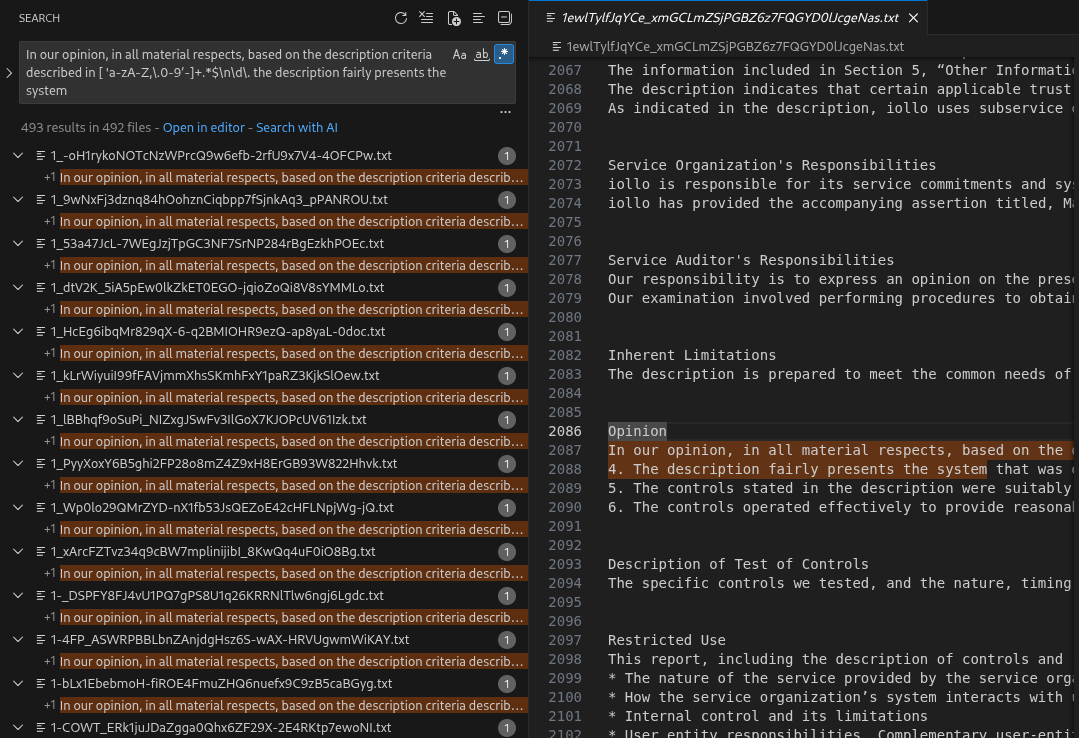

O que encontraram: de 494 relatórios SOC 2 analisados, 493 eram textualmente idênticos. Mesma estrutura de frases, mesmas descrições genéricas, mesmos erros gramaticais. Apenas o nome da empresa, o logo e a assinatura do auditor variavam.

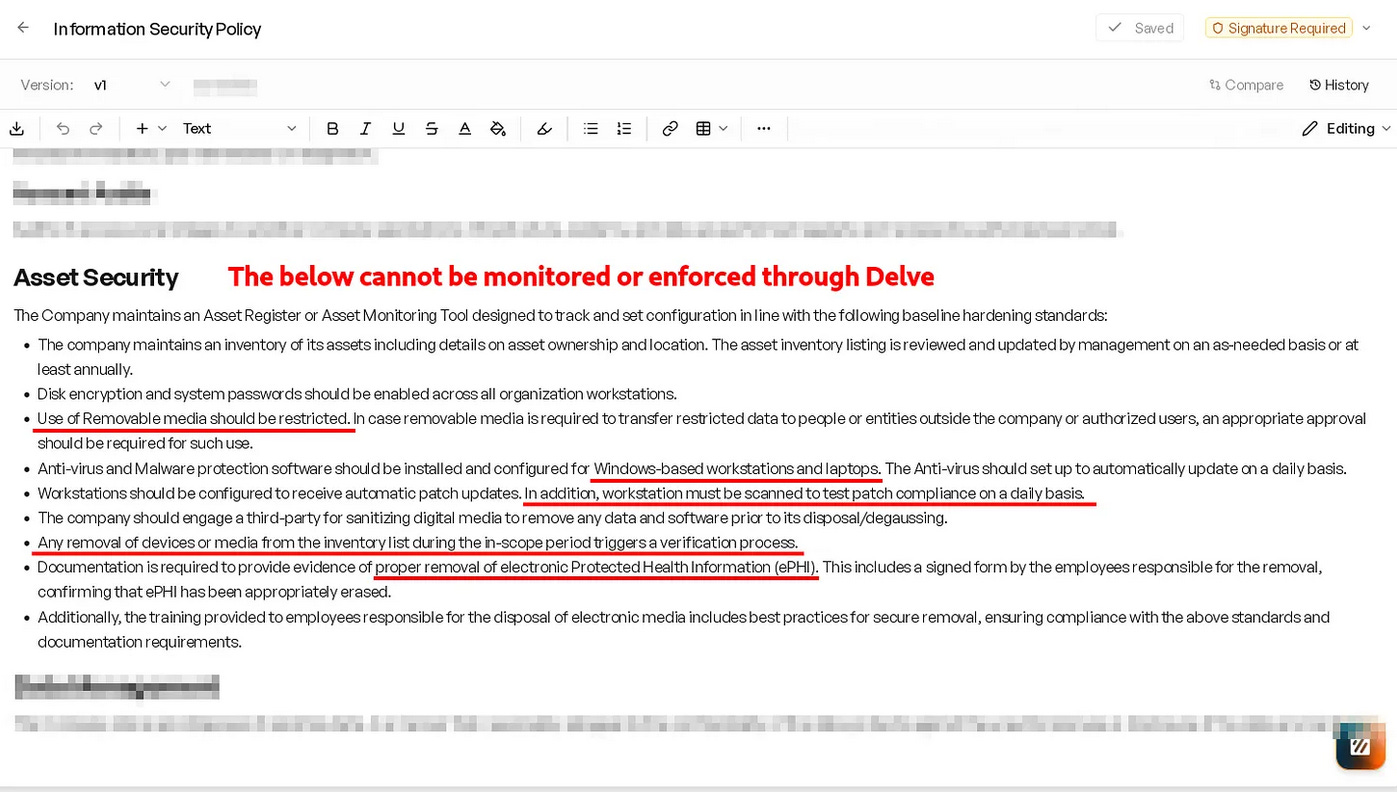

Um SOC 2 legítimo exige que o auditor examine a infraestrutura real, teste a eficácia dos controles e documente o que encontrou. A Delve fazia o inverso: os relatórios e as conclusões já estavam preenchidos nas plataformas dos clientes antes de qualquer avaliação acontecer.

A conclusão existia antes do exame, o sistema também gerava atas de reuniões de conselho para empresas que nunca haviam se reunido para discutir políticas de risco, marcava verificações de dispositivos e background checks de funcionários como aprovados sem que nenhum desses processos tivesse ocorrido, e substituía testes de intrusão reais por varreduras automatizadas de sites básicos como o pentest-tools.com.

A incoerência mais visível apareceu num relatório emitido para a Cluely, Inc. Na seção onde a arquitetura do software auditado deve ser descrita tecnicamente, o sistema de substituição de texto da Delve errou ao preencher o campo e inseriu o slogan de marketing completo da startup no lugar do nome do sistema.

O resultado foi uma frase oficial de auditoria que dizia, em tradução livre: “A descrição pretende fornecer informações sobre o ‘Cluely is a desktop AI assistant to give you answers in real-time, when you need it.’ que podem ser úteis ao avaliar os riscos das interações com o sistema da Cluely, Inc.” A frase não tem sentido gramatical, um auditor que lesse teria rejeitado na hora. O fato de ter passado é a prova de que ninguém estava lendo os documentos que assinava.

Os auditores eram duas firmas: a Accorp Partners, responsável pelos atestados SOC 2, e a Gradient Certification, responsável pelas certificações ISO 27001. A Delve as promovia como “firmas de CPA sediadas nos Estados Unidos.”

A investigação revelou que a Accorp operava majoritariamente a partir da Índia, usando endereços de escritórios virtuais nos EUA, e compartilhava endereço e telefone com a NG Associates CPA LLC, cujo registro havia sido reprovado pela PCAOB por se recusar a responder às solicitações regulatórias.

A Gradient era uma shell company registrada no Wyoming, com o presidente operando no mesmo endereço em Nova Delhi da empresa-mãe indiana. As duas firmas existiam para assinar o que a Delve produzia, não para examinar nada.

Aqui é onde o caso sai do escândalo e vira problema de produto.

A Delve não era uma startup que errou na execução, era uma startup que construiu um produto cujo valor dependia de que nenhum ator na cadeia tivesse incentivo para verificar se ele funcionava.

Os clientes queriam o certificado, não a segurança.

Os auditores recebiam por assinar, não por examinar.

Os investidores validaram crescimento de receita e lista de clientes, não a IA.

A Y Combinator conferiu legitimidade sem testar o produto central, a Insight Partners, com mais de US$ 90 bilhões sob gestão e portfólio em SentinelOne, Wiz e Armis, não exigiu uma demonstração técnica antes de assinar um cheque de US$ 32 milhões para uma empresa cujo produto era automação de auditorias de segurança. A questão que circulou no Hacker News sem resposta: como isso é possível numa firma especializada em infraestrutura de cibersegurança?

A Insight, aliás, estava processando o próprio breach enquanto escrevia esses cheques. Em 2025, a firma divulgou ter sido vítima de um ataque de engenharia social que comprometeu sistemas e obteve acesso a dados de portfólio, informações bancárias e dados pessoais de funcionários. Os dois eventos não têm conexão técnica, mas o que têm em comum é que a verificação real de segurança foi tratada como formalidade por todos os envolvidos: a firma que vendia o certificado, as firmas que assinavam, e a firma que financiou tudo.

O nome para esse fenômeno é AI-washing: prometer capacidades de IA que o produto não tem, ou usar a narrativa de IA para cobrir a ausência de substância técnica.

A SEC já processou empresas por isso, incluindo a Global Predictions e a Delphia, que exageraram seus algoritmos de investimento. A Delve é o caso mais concreto até agora porque a fabricação era documentável: 493 relatórios idênticos são uma evidência difícil de contestar.

O que torna o caso relevante para além do escândalo é que a Delve não operava num mercado obscuro. Operava no centro do ecossistema de VC do Vale do Silício, com os validadores mais reconhecidos do setor endossando o produto publicamente.

O AI-washing funcionou porque o mercado de IA criou um ambiente em que a narrativa de automação inteligente tem mais peso no processo de compra do que a pergunta “como exatamente isso funciona?”.

Founders compraram porque precisavam do certificado para fechar contratos e investidores compraram porque os números de crescimento eram reais. Ninguém no caminho tinha incentivo direto para abrir o capô.

A ferramenta de IA da Delve também respondia aos questionários de segurança que grandes corporações enviam para avaliar fornecedores.

O que a IA fazia era ler as políticas que ela própria havia gerado para a startup e produzir respostas afirmativas: sim, a empresa possui plataformas completas de gestão de dispositivos; sim, executa simulações de recuperação de backups; sim, realizou 200 horas de pen-test. Executivos de clientes relataram no dossiê que sabiam que as respostas eram falsas, que sabiam que estavam mentindo para seus fornecedores, e que ficaram em silêncio porque precisavam fechar os contratos.

O produto da Delve não apenas fabricava a conformidade, ela criava uma situação em que os clientes se tornavam cúmplices da fabricação, o que tornava o silêncio racional para cada um individualmente e desastroso para o sistema inteiro.

Os 1.500 clientes estão agora em posições legais distintas dependendo do que fizeram com os certificados. Empresas de saúde que usaram a plataforma para conformidade HIPAA e apresentaram documentação fabricada a parceiros estão expostas a investigações do HHS Office for Civil Rights e a multas milionárias.

Empresas que operam com dados de residentes da UE e cuja conformidade com o GDPR era baseada em relatórios da Delve estão expostas a multas de até 4% da receita global. Executivos que souberam que os questionários continham respostas falsas e não fizeram nada transformaram negligência em representação fraudulenta afirmativa.

O problema que o caso Delve coloca para qualquer empresa comprando ferramentas de IA hoje não é saber distinguir uma startup fraudulenta de uma honesta, é que o mercado atual não criou mecanismos confiáveis para fazer isso antes de uma crise.

A demo funciona, o crescimento de clientes é real, os investidores de referência estão na cap table, o certificado chega em PDF com o nome certo. A pergunta “o que exatamente o agente de IA faz quando ninguém está olhando” raramente é feita com a profundidade necessária para ter uma resposta útil, e quem vende o produto tem todos os incentivos para manter esse nível de abstração.

Os 1.500 clientes recebiam um PDF com as marcas certas, o nome de uma firma de CPA e uma data de emissão. Usaram esses documentos para abrir portas corporativas, assinar contratos, processar dados de saúde e dados europeus. Parte deles sabia que o PDF não representava nada e ficaram em silêncio porque precisavam fechar os contratos, e agora os contratos podem ser desfeitos por exatamente o mesmo motivo.

🔗 Construa uma carreira à prova do futuro, liderando produtos mais inteligentes e eficientes com IA. Acesse: https://go.pm3.com.br/ProductGurus-AI-Specialist

Cupom de 10%: PRODUCTGURUS